Beam Cloud

Облачная платформа для serverless-ворклоадов на CPU/GPU. Запускайте Docker-образы как REST API за <1 сек. Автомасштабирование, оплата за миллисекунды.

Обзор Beam Cloud

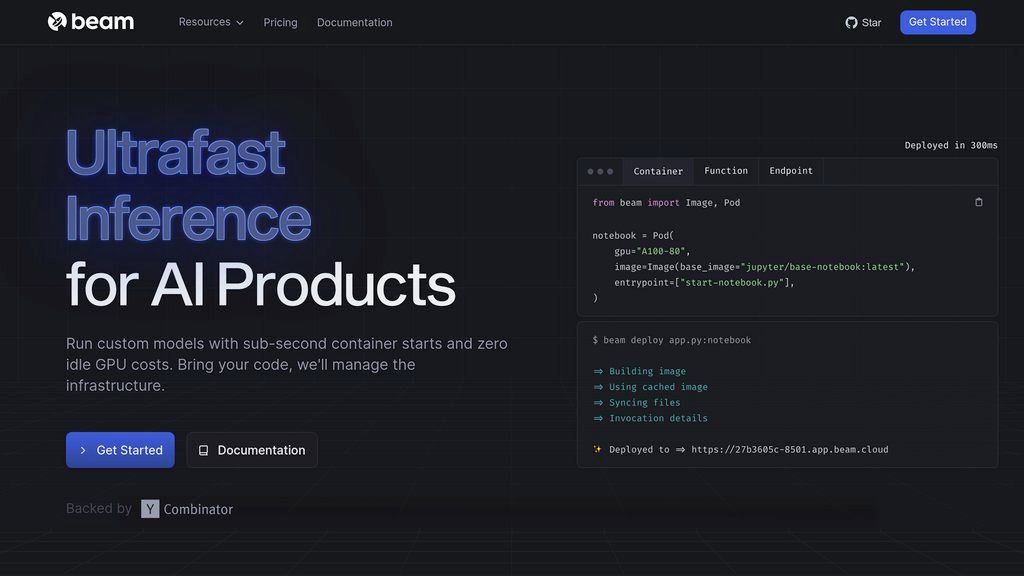

Beam Cloud — это облачная инфраструктура, которая позволяет запускать serverless-ворклоады на CPU и GPU. Платформа автоматически управляет сложной инфраструктурой, включая оркестрацию контейнеров, автомасштабирование и обработку одновременных запросов. Благодаря этому разработчики могут сосредоточиться на написании кода, а не на администрировании Kubernetes или облачных аккаунтов. Вы можете развернуть существующие Docker-образы как REST API или запускать функции, запланированные задачи и асинхронные очереди. Основная задача Beam Cloud — избавить вас от рутины управления инфраструктурой, предоставив мгновенный доступ к вычислительным ресурсам. Это особенно актуально для задач, требующих гибкости и масштабируемости, таких как ML-инференс, обработка данных или веб-сервисы, где требуется быстрая реакция на изменения нагрузки и оплата только за фактически использованное время.

Главные функции

Мгновенный запуск контейнеров

Развертывайте Docker-контейнеры в облаке менее чем за одну секунду, значительно ускоряя циклы разработки и тестирования.

Serverless на CPU и GPU

Запускайте ваши приложения и задачи на масштабируемых CPU и GPU ресурсах без необходимости управлять базовой инфраструктурой.

Гибкие варианты развертывания

Легко развертывайте синхронные REST API, асинхронные очереди задач, запланированные задания и долгоживущие функции.

Автомасштабирование и параллелизм

Автоматически масштабируйте ваши ворклоады до тысяч контейнеров в зависимости от нагрузки, оптимизируя использование ресурсов.

Оплата по факту использования

Оплачивайте только фактически отработанное время вычислений с точностью до миллисекунды, обеспечивая максимальную экономическую эффективность.

Плюсы и минусы

Преимущества

- Скорость развертывания и запуска контейнеров (<1 секунда).

- Полностью управляемая инфраструктура: нет необходимости в Kubernetes или ручном масштабировании.

- Гибкая модель оплаты (pay-per-millisecond) для оптимизации затрат.

Недостатки

- Зависимость от качества Docker-образов и конфигурации.

- Может потребовать адаптации существующих приложений для serverless-архитектуры.

- Стоимость может стать значительной при постоянной высокой нагрузке.

Для кого и как использовать?

ML Engineer

Быстрое развертывание и тестирование ML-моделей (инференс) как REST API на GPU. Автомасштабирование под пиковые нагрузки запросов и оплата только за время работы модели.

Backend Developer

Создание масштабируемых веб-сервисов и API. Развертывание существующих Docker-образов без управления серверами, с мгновенным стартом и оплатой за миллисекунды.

Data Scientist

Запуск задач пакетной обработки данных или асинхронных очередей на мощных CPU/GPU. Автоматическое масштабирование для обработки больших объемов данных и оплата по факту использования.

Частые вопросы

Похожие нейросети и аналоги

Смотреть все

Zed

Zed — высокопроизводительный редактор кода на Rust с ИИ-помощником (Claude 3.5 Sonnet) и функциями совместной работы для разработчиков.

Zeabur

Zeabur — PaaS для разработчиков. Автоматический деплой любых языков, интеграция сервисов, оплата по факту использования. Ускорьте разработку.

智谱

Платформа Z.ai с открытыми моделями GLM (9B-32B) для кода, исследований и сложных задач. Скорость до 200 токен/сек.

Xata.io

Облачная PostgreSQL платформа для масштабируемых приложений. Мгновенные ветки, миграции без простоя, BYOC, встроенный поиск.

Workato

Workato — платформа для интеграции и автоматизации бизнес-процессов с помощью low-code/no-code и AI-ассистентов. Решает задачи бизнеса для разных отделов.

Wispr Flow

Wispr Flow — платформа голосового ИИ для быстрой диктовки текста. Повышает продуктивность разработчиков и писателей, поддерживая 100+ языков и интеграцию с любыми приложениями.