MCP сервер что это и зачем он нужен вайбкодерам в 2026 году

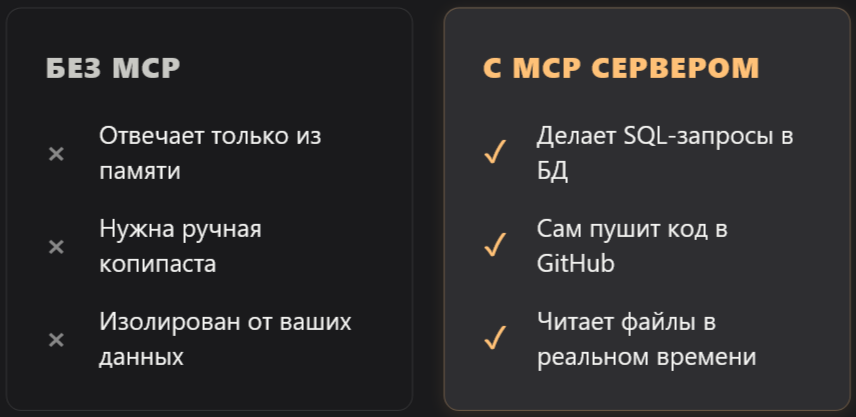

MCP сервер — это небольшая программа-посредник, которая дает AI-ассистенту (Claude, Cursor, Windsurf) доступ к внешним инструментам и данным через единый стандартный протокол. Проще говоря: без MCP ваш AI умеет только болтать. С MCP — он лезет в базу данных, пушит код в GitHub, читает ваши заметки в Obsidian, ищет по сети. И всё это прямо в разговоре, без копипасты.

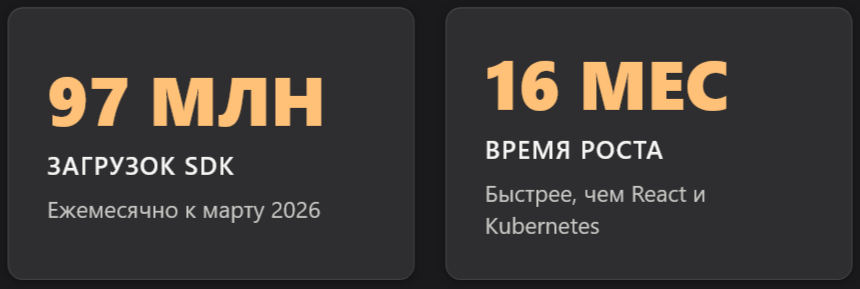

К марту 2026 года Model Context Protocol набрал 97 млн загрузок SDK в месяц — быстрее React, быстрее Kubernetes. Anthropic открыла его в ноябре 2024, а к декабрю 2025 передала под крыло Linux Foundation. Сегодня MCP поддерживают Claude, ChatGPT, Cursor, Windsurf, VS Code с Copilot, JetBrains и Google Gemini. В этой статье разберем, как это работает, зачем нужно и как начать использовать в реальных проектах.

Почему AI без MCP — это умный, но беспомощный ассистент

Представьте: вы нанимаете аналитика, который знает все на свете, но не может открыть ни один файл на вашем компьютере. Не может залезть в CRM, не может проверить базу данных, не может даже загуглить. Он просто отвечает из памяти.

Вот так работал LLM до появления MCP. Мощный, умный, но изолированный. Разработчики решали это по-разному: писали кастомные интеграции для каждого инструмента отдельно, подсовывали AI текстовые выгрузки руками, копировали данные туда-обратно. Это работало, но накапливало кучу «клейкого кода» (glue code) — специфичных интеграций, которые разваливались при каждом обновлении API.

Проблема не в написании кода. Проблема в поддержке. Как только Yahoo Finance меняет структуру ответа — всё, нужно переписывать. Умножьте это на 20 инструментов в 10 проектах. Именно этот кошмар и пришел решать MCP.

Что такое MCP сервер простым языком

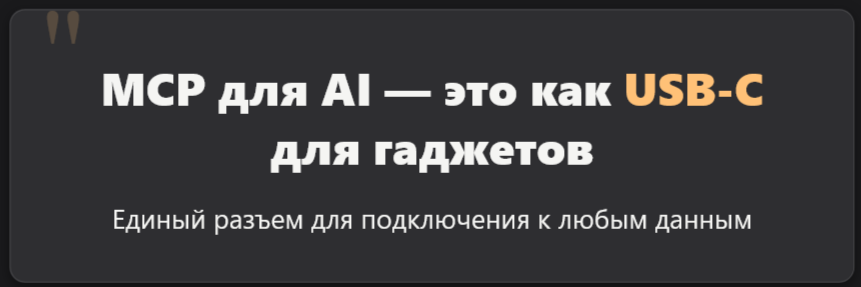

MCP расшифровывается как Model Context Protocol — протокол контекста модели. Это открытый стандарт, описывающий, как AI-системы подключаются к внешним инструментам и данным.

Аналогия из реальной жизни: USB-C. До его появения у каждого устройства был свой кабель. Ноутбук — один разъем, телефон — другой, мышь — третий. Потом пришел USB-C и стал универсальным разъемом для всех. MCP сделал то же самое для AI: ввел единый «разъем», через который LLM может подключаться к чему угодно.

MCP сервер — это конкретная реализация этого стандарта для одного инструмента. Например:

- MCP сервер для GitHub — дает AI доступ к репозиториям, pull requests, issues

- MCP сервер для Postgres — позволяет AI делать SQL-запросы на естественном языке

- MCP сервер для Obsidian — дает AI читать и писать заметки в вашем vault

- MCP сервер для Figma — позволяет AI читать дизайн-макеты и генерировать код по ним

Каждый такой сервер описывает свои возможности в виде «инструментов» (tools) на обычном языке. AI читает эти описания и сам понимает, когда и как их вызвать.

Максим: «Когда я подключил MCP сервер для Obsidian к Claude, у меня было ощущение, что AI стал частью рабочего пространства, а не отдельным чатом. Пишешь — и он сразу кладет заметку куда надо. Для NanaBanana мы используем похожую схему: Claude через MCP дергает нужные данные и сразу делает с ними что нужно, без промежуточного копипаста. Экономит в разы.»

Как MCP сервер работает изнутри

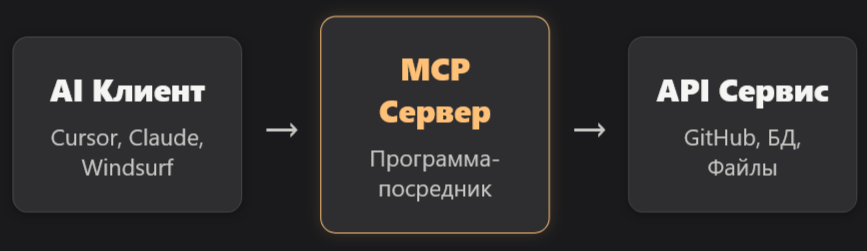

Схема работы трехступенчатая: клиент → MCP сервер → внешний сервис.

Клиент — это ваш AI-инструмент: Cursor, Claude Desktop, Windsurf, VS Code.

MCP сервер — промежуточная программа. При запуске она сообщает клиенту список своих инструментов через вызов list_tools. Каждый инструмент описан в виде текста: что делает, какие параметры принимает, что возвращает.

Внешний сервис — это уже обычный API, база данных, файловая система — всё что угодно.

Вот как это выглядит на практике:

- Вы пишете в Cursor: «Найди все открытые issues в репозитории с меткой bug»

- AI видит, что у него есть GitHub MCP сервер с инструментом

search_issues - Из вашего запроса AI сам вытаскивает параметры: репозиторий, метка

- AI вызывает инструмент через MCP

- MCP сервер делает HTTP-запрос к GitHub API

- Результат возвращается AI, который отвечает вам уже с данными

Для вас это выглядит как магия. За кулисами — простой, но хорошо стандартизированный пайплайн.

Три типа возможностей MCP сервера

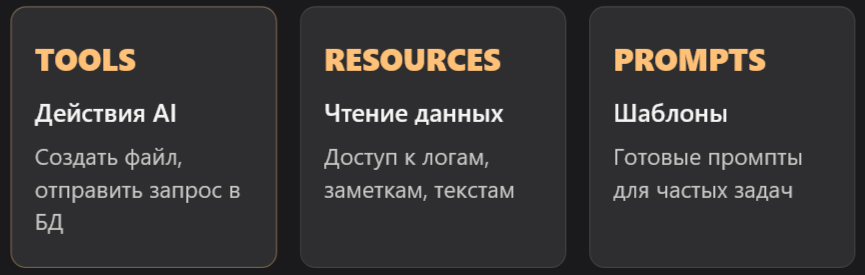

Каждый MCP сервер может предоставлять три вида возможностей:

| Тип | Что это | Пример |

|---|---|---|

| Tools | Действия, которые AI может совершать | Создать задачу, отправить запрос, сохранить файл |

| Resources | Данные, которые AI может читать | Файлы, записи БД, документы |

| Prompts | Готовые шаблоны для типовых запросов | Системный промпт для работы с конкретным API |

В большинстве случаев вы будете работать с Tools — именно они дают AI способность «делать» что-то, а не только «знать».

Почему MCP стал стандартом так быстро

Это реально удивительная история. За 16 месяцев — с ноября 2024 по март 2026 — количество загрузок SDK выросло с 2 млн до 97 млн в месяц. React на такой масштаб потратил три года. Kubernetes — почти четыре.

Три причины, почему MCP взлетел так быстро.

Первая: открытый стандарт без платежей и ограничений. Anthropic выпустила MCP под MIT лицензией. Любая компания могла взять и внедрить без разрешений, договоров и роялти. Это убрало главный барьер корпоративного внедрения.

Вторая: технически простая реализация. JSON-RPC поверх стандартных транспортов. Любой разработчик, знакомый с JSON, мог написать MCP сервер за пару часов. Anthropic дополнительно выпустила готовые реализации для GitHub, Slack, Postgres и Google Drive — сразу дав сообществу точку старта.

Третья: все крупные игроки пришли сами. OpenAI внедрила поддержку MCP в начале 2025. Google — в начале 2026. Когда каждая крупная AI-лаборатория добавляет поддержку протокола — альтернативы перестают иметь смысл. В декабре 2025 Anthropic передала MCP в Agentic AI Foundation при Linux Foundation. Теперь протокол принадлежит индустрии, а не одной компании — как Kubernetes, Linux и PyTorch.

К апрелю 2026 года 78% корпоративных AI-команд имеют хотя бы одного MCP-агента в продакшне. Реестр серверов вырос с 1200 в начале 2025 до более 9000 к апрелю 2026.

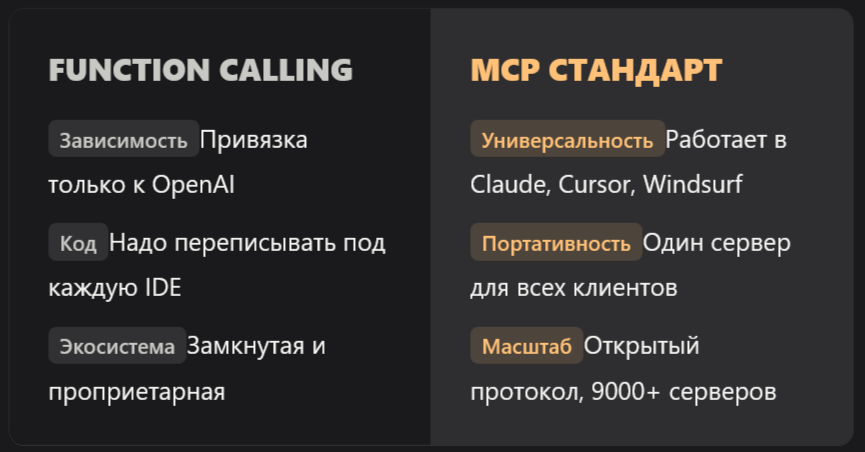

MCP vs Function Calling: в чем разница

Если вы уже работали с OpenAI API, возможно видели Function Calling — похожий механизм, когда AI вызывает заранее описанные функции. Чем MCP отличается?

| Критерий | Function Calling | MCP |

|---|---|---|

| Зависимость от провайдера | Только OpenAI | Работает везде |

| Переносимость | Нет (надо переписывать) | Один сервер — все клиенты |

| Кто пишет интеграцию | Разработчик приложения | Создатель сервиса один раз |

| Стандартизация | Проприетарная | Открытый протокол |

| Экосистема | Замкнутая | 9000+ готовых серверов |

Function Calling — это механизм конкретного провайдера. Написал интеграцию для ChatGPT, переписывай для Claude. MCP — один сервер, один конфиг, работает в Cursor, Windsurf, Claude Desktop и VS Code одновременно.

Какие MCP серверы реально полезны для вайбкодинга

Сейчас в публичных реестрах (Glama, mcp.so, Smithery) тысячи серверов. Большинство — дубли или weekend-проекты. Вот те, что реально работают и экономят время.

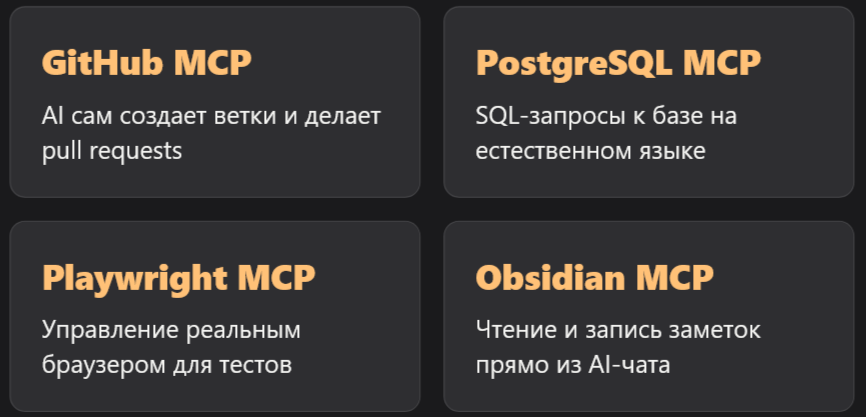

Для работы с кодом

GitHub MCP — самый нужный. AI сам создает ветки, делает pull requests, читает issues, ищет по коду. Подключается к claude_desktop_config.json или .cursor/mcp.json за 5 минут.

Playwright MCP (от Microsoft) — дает AI управление реальным браузером. Нужен для тестирования, скрапинга, визуальных проверок. Работает через дерево доступности, что быстрее и стабильнее подходов со скриншотами.

Filesystem MCP — доступ к локальным файлам. Читать, писать, создавать, перемещать. Работает в паре с любым AI IDE.

Для работы с данными

PostgreSQL MCP — SQL-запросы на естественном языке. «Покажи 10 пользователей, зарегистрировавшихся на этой неделе с наибольшей активностью» превращается в реальный запрос с результатами. Есть режим read-only для безопасной работы.

Supabase MCP — аналог для тех, кто работает на Supabase. Прямой доступ к таблицам, auth, storage.

Firecrawl MCP — веб-скрапинг внутри редактора. Агент сам планирует стратегию, собирает данные из нескольких источников, возвращает структурированный результат.

Для продуктивности

Obsidian MCP — читать и писать заметки прямо из AI-разговора. Подключается через Obsidian REST API plugin.

Figma MCP (официальный, с марта 2025) — AI читает дизайн-макеты, извлекает данные о layout, переводит в код. Нужен Figma access token.

Sentry MCP — AI сам смотрит ошибки в продакшне и предлагает исправления прямо с контекстом стека.

Таблица: с чего начать в зависимости от задачи

| Задача | MCP сервер | Приоритет |

|---|---|---|

| Работа с репозиторием | GitHub MCP | Первый |

| Запросы к БД | PostgreSQL / Supabase MCP | Первый |

| Автоматизация браузера | Playwright MCP | Второй |

| Дизайн в код | Figma MCP | Второй |

| Личная база знаний | Obsidian MCP | По желанию |

| Веб-данные | Firecrawl MCP | По желанию |

| Мониторинг ошибок | Sentry MCP | По желанию |

Начните с двух-трёх серверов, которые покрывают ваш ежедневный сценарий. Потом добавите по мере необходимости.

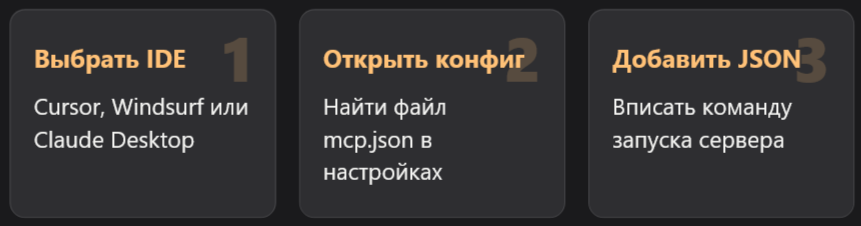

Как подключить MCP сервер в Cursor, Claude и Windsurf

Все три инструмента используют одинаковый формат конфигурации — JSON-файл. Разница только в расположении.

Claude Desktop: claude_desktop_config.json в папке настроек. Открывается через Settings > Developer > Edit Config.

Cursor: .cursor/mcp.json в корне проекта или глобальный файл в настройках.

Windsurf: аналогичный JSON-конфиг в настройках IDE.

Базовая структура конфига:

{

"mcpServers": {

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_TOKEN": "ваш_токен"

}

}

}

}Для удаленных MCP серверов (не локальных) используется другой формат — URL и transport SSE:

{

"mcpServers": {

"remote-server": {

"url": "https://example.com/mcp",

"transport": "sse"

}

}

}Ключевой момент: один и тот же MCP сервер работает во всех клиентах без изменений. Настроили GitHub MCP для Cursor — он же работает в Windsurf и Claude Code с минимальными правками.

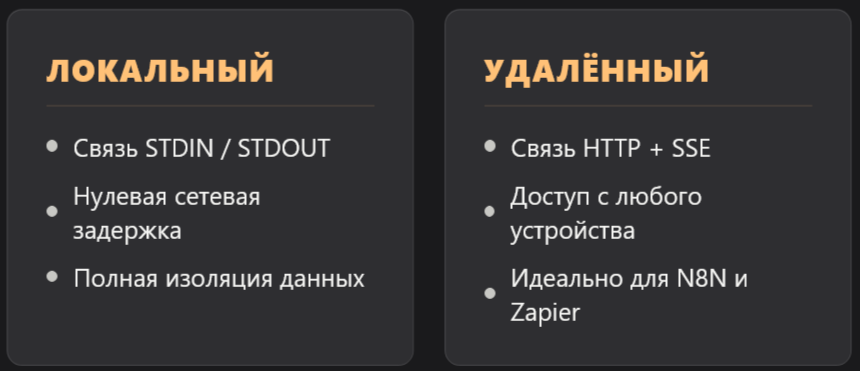

Локальный vs удаленный MCP сервер

Локальный сервер запускается прямо на вашем компьютере и общается с AI через стандартный ввод-вывод (STDIN/STDOUT). Никакой сетевой задержки, полная изоляция данных.

Удаленный сервер работает где-то в интернете и общается по HTTP с SSE-транспортом. Требует аутентификацию, но доступен с любого устройства. Это то, что нужно, если хотите подключить MCP к N8N, Zapier или собственному бэкенду.

Как создать свой MCP сервер

Готовых серверов сейчас тысячи, но иногда нужно что-то специфическое. Хорошая новость: написать простой MCP сервер — проще, чем кажется.

Anthropic предоставляет SDK для Python и TypeScript. Минимальная структура сервера на Python:

from mcp.server import Server

from mcp.types import Tool

server = Server("my-server")

@server.list_tools()

async def list_tools():

return [

Tool(

name="get_data",

description="Получает данные из внутренней системы по ID",

inputSchema={

"type": "object",

"properties": {

"id": {"type": "string", "description": "ID записи"}

},

"required": ["id"]

}

)

]

@server.call_tool()

async def call_tool(name: str, arguments: dict):

if name == "get_data":

# ваша логика здесь

return {"result": f"Данные для {arguments['id']}"}Ключевая вещь — описание инструмента (description). Именно по нему AI решает, вызвать этот инструмент или нет. Чем точнее описание — тем лучше работает автовыбор. Автор видео Network Chuck советует использовать Claude Opus для генерации начального кода сервера — с хорошим промптом получается рабочая основа за один раз.

Если хотите упаковать сервер в Docker (рекомендуется для production), Docker Desktop с MCP toolkit берет на себя запуск, управление секретами и регистрацию сервера в каталоге.

Типичные ошибки при работе с MCP

Неправильный JSON в конфиге. Одна лишняя запятая — и весь файл не парсится. Проверяйте через jsonlint.com перед сохранением.

Проблемы с переменными окружения. Если сервер требует API ключ, убедитесь что он передан через поле env, а не захардкожен в коде.

Слишком много серверов сразу. 15 MCP серверов в конфиге — это не производительность, это путаница. AI начинает дольше выбирать инструмент, иногда ошибается. Начинайте с 3-5.

Ожидание что всё работает из коробки. Локальные модели (Llama, Gemma) значительно хуже справляются с вызовом MCP инструментов, чем Claude или GPT. Если тестируете на локальной модели и что-то не работает — проблема может быть в модели, не в сервере.

Игнорирование разрешений. Claude Desktop по умолчанию спрашивает подтверждение при каждом вызове инструмента. Это не баг, это фича безопасности. Можно настроить автоподтверждение для доверенных серверов.

Что реально меняет MCP в работе вайбкодера

Без MCP AI-ассистент — это умный коллега, которому надо всё пересказывать вручную. Скопировать ошибку из консоли, вставить в чат, скопировать ответ, вставить в код. Туда-обратно.

С MCP цикл ломается. AI сам смотрит в вашу базу данных. Сам читает ошибку из Sentry. Сам создает ветку в GitHub после того, как написал код. И всё это в рамках одного разговора.

На практике это меняет не только скорость, но и качество задач. Когда AI имеет прямой доступ к данным — он не галлюцинирует структуру таблицы, не придумывает API, которого не существует. Он видит реальное.

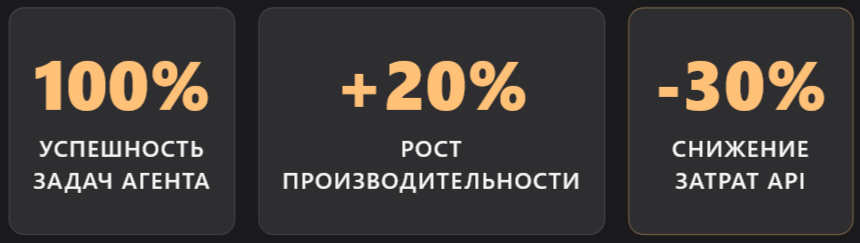

По данным тестов Twilio: после внедрения MCP-интеграций успешность выполнения задач агентом выросла с 92% до 100%, производительность агентов улучшилась на 20%, а вычислительные затраты снизились до 30%.

Это не маркетинг. Это то, что происходит, когда AI перестает работать вслепую.

FAQ по MCP серверам

Что такое MCP сервер простыми словами?

Небольшая программа-переходник между вашим AI-ассистентом и внешним сервисом. Пишет её один раз разработчик сервиса, а вы просто подключаете и пользуетесь — без кода с вашей стороны.

Чем MCP отличается от обычного плагина?

Плагин работает только в одном приложении. MCP сервер работает в любом клиенте, поддерживающем протокол: Cursor, Claude, Windsurf, VS Code — везде один конфиг.

Нужно ли платить за MCP серверы?

Сами серверы в большинстве случаев бесплатны и с открытым кодом. Платите только за сервисы, к которым они подключаются: GitHub, Supabase, Figma — по тарифам этих сервисов.

Сколько MCP серверов можно подключить одновременно?

Технического лимита нет, но на практике 3-5 — оптимум для большинства сценариев. Больше серверов — дольше выбор инструмента, выше вероятность ошибки AI при выборе.

Работает ли MCP с локальными языковыми моделями?

Работает, но хуже. Локальные модели вроде Llama 3 или Gemma справляются с вызовом инструментов значительно хуже, чем Claude или GPT. Для серьезной работы рекомендуется использовать облачные модели.

Безопасно ли давать AI доступ к моим файлам и данным через MCP?

Локальные MCP серверы работают только на вашей машине, данные никуда не уходят. Claude Desktop запрашивает подтверждение перед каждым действием. Удаленные серверы требуют дополнительной настройки прав доступа.

Как найти MCP серверы под мои задачи?

Основные каталоги: Smithery (~6000 серверов), mcp.so, Glama. Для начала достаточно официального реестра Anthropic — там проверенные серверы для GitHub, Slack, Google Drive, Postgres и других популярных инструментов.

Глоссарий MCP

MCP (Model Context Protocol) — открытый протокол стандартизации взаимодействия AI-систем с внешними инструментами и данными. Создан Anthropic в ноябре 2024, передан в Linux Foundation в декабре 2025.

MCP клиент — AI-инструмент, который использует MCP серверы. Например: Claude Desktop, Cursor, Windsurf, VS Code с Copilot.

MCP сервер — программа, предоставляющая AI доступ к конкретному инструменту или сервису через протокол MCP.

Tools — действия, которые MCP сервер предоставляет AI. Например: создать файл, сделать SQL-запрос, отправить сообщение.

Resources — данные, доступные для чтения через MCP. Файлы, записи БД, документы.

Prompts — готовые шаблоны запросов, которые MCP сервер предлагает AI для типовых сценариев.

JSON-RPC — протокол удаленного вызова процедур на основе JSON. Транспорт, который использует MCP для передачи сообщений.

STDIN/STDOUT transport — способ связи для локальных MCP серверов. Быстро, без сетевой задержки, данные остаются на вашей машине.

SSE transport — способ связи для удаленных MCP серверов. HTTP + Server-Sent Events, нужен для доступа через интернет.

Glue code — «клейкий код»: специфические интеграции, которые разработчики писали вручную до появления MCP для каждого сервиса отдельно.

AAIF (Agentic AI Foundation) — фонд при Linux Foundation, который управляет развитием протокола MCP с декабря 2025. Участники: Anthropic, OpenAI, Google, Microsoft, AWS, Cloudflare.

Что дальше

MCP уже не эксперимент — это базовая инфраструктура AI-разработки в 2026 году. Если вы работаете в Cursor или Windsurf и не используете MCP серверы, вы тратите время на ручную работу, которую AI мог бы делать сам.

Начните с GitHub MCP и одного сервера для вашей базы данных. Потратите 10 минут на конфиг — и следующие недели будете удивляться, как работали без этого.

На vibecoderz.ru/ide собран каталог AI IDE и инструментов — там можно посмотреть, какие клиенты поддерживают MCP и как начать работу с каждым из них.

Если хотите разобраться в настройке под конкретный стек или построить собственный MCP сервер — запишитесь на консультацию к Максиму. Он прошел через это на реальных проектах и покажет кратчайший путь.

Последнее обновление: май 2026. Данные о количестве загрузок и серверов актуальны на март–апрель 2026 года.