MCP сервер с Ollama и LM Studio 2026: запускаем ИИ локально без облака

Запустить MCP сервер с локальной моделью реально за 20-30 минут. Ollama даёт вам LLM на своём железе, LM Studio с версии 0.3.17 умеет подключаться к MCP серверам напрямую из интерфейса. Никаких API-ключей, никакой отправки данных вовне.

В этой статье разберём: что такое MCP сервер для LLM, как работает связка с Ollama, как настроить LM Studio через mcp.json, какие модели поддерживают tool calling, и где эта схема реально работает, а где у неё жёсткие ограничения.

Что такое MCP сервер и зачем он нужен локально

MCP (Model Context Protocol) — открытый стандарт от Anthropic для подключения LLM к внешним инструментам. Представьте: вы спрашиваете модель о данных из базы, она делает SQL-запрос, получает результат и отвечает. Без MCP вам пришлось бы писать весь этот «клей» вручную под каждый инструмент.

Аналогия из жизни: USB-C вместо зоопарка кастомных разъёмов. Любой MCP сервер подключается к любому MCP клиенту по единому интерфейсу.

Три компонента схемы:

- MCP сервер — программа, которая оборачивает внешний инструмент (базу данных, файловую систему, API) и предоставляет его модели в виде «tools»

- MCP клиент — приложение, которое подключается к серверу и передаёт инструменты в LLM (Cursor, Claude Desktop, LM Studio, ваш собственный агент)

- LLM — модель, которая решает, какой инструмент вызвать и с какими аргументами

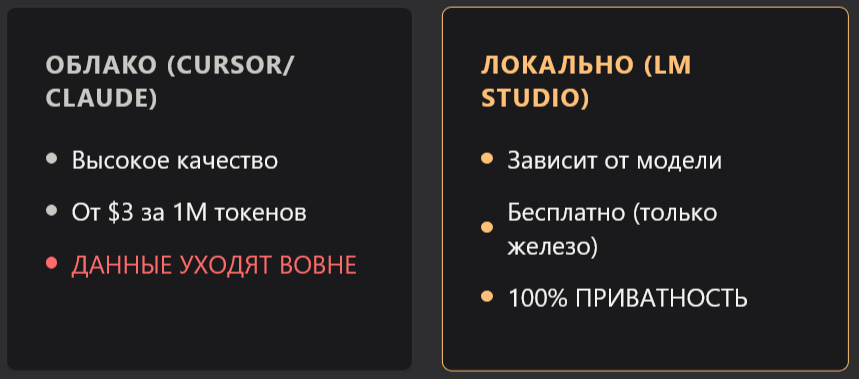

Проблема облачных клиентов: Claude Desktop и Cursor отправляют данные на серверы Anthropic или OpenAI. Если вы работаете с корпоративными данными или просто цените приватность, это вариант не подходит. Локальный стек решает этот вопрос полностью.

| Компонент | Облачный вариант | Локальный вариант |

|---|---|---|

| LLM | Claude, GPT-4o | Ollama + Qwen3/Llama |

| MCP хост | Claude Desktop, Cursor | LM Studio 0.3.17+, MCPHost |

| Данные уходят вовне | Да | Нет |

| Качество работы | Высокое | Зависит от модели |

| Стоимость | $3-25 / 1M токенов | 0 (только железо) |

Как работает Ollama с MCP серверами

Сразу честно: по состоянию на апрель 2026 года Ollama не поддерживает MCP нативно. Запрос на GitHub (issue #7865) остаётся открытым. Ollama — это inference-сервер с tool calling, но не MCP клиент.

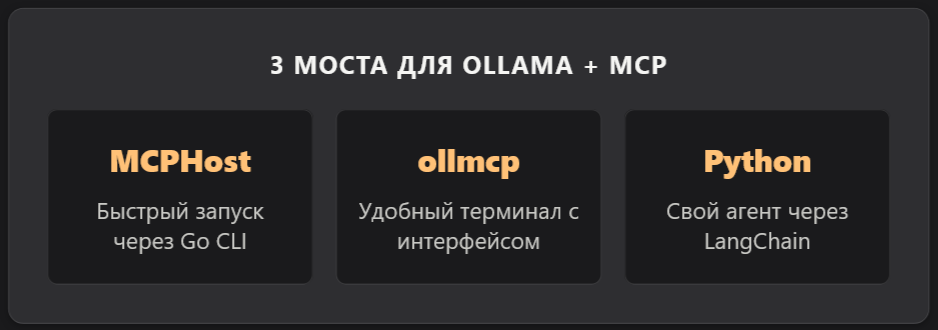

Чтобы соединить Ollama с MCP сервером, нужен мост. Три рабочих подхода:

MCPHost — самый быстрый старт

MCPHost — это Go CLI, который соединяет любую Ollama-модель с любым MCP сервером. Он берёт на себя обнаружение инструментов, конвертацию схем и цикл вызов-выполнение-ответ.

# Установка (нужен Go 1.22+)

go install github.com/mark3labs/mcphost@latest

# Запуск с конфигом серверов

mcphost -m ollama:qwen3:14b --config mcp-servers.jsonКонфиг mcp-servers.json:

{

"mcpServers": {

"filesystem": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-filesystem", "/Users/you/projects"]

}

}

}Плюс MCPHost: можно переключить модель одной строкой. mcphost -m anthropic:claude-sonnet-4-20250514 — и тот же конфиг работает с облачной моделью. Удобно для сравнения качества.

mcp-client-for-ollama — TUI с управлением

mcp-client-for-ollama (ollmcp) — интерактивный терминальный клиент для подключения Ollama к нескольким MCP серверам одновременно. Поддерживает переключение моделей, агентный режим с ограничением итераций и human-in-the-loop.

pip install mcp-client-for-ollama

ollmcpСобственный клиент на Python

Для тех, кто хочет встроить это в своё приложение. Схема из видео (транскрипция из CSV): создаёте BasicMCPClient, подключаетесь к серверу по SSE или stdio, используете MCPToolSpec для конвертации инструментов в формат агента, запускаете LlamaIndex или LangChain агента с Ollama в качестве LLM.

from llama_index.tools.mcp import BasicMCPClient, MCPToolSpec

client = BasicMCPClient("http://localhost:8000/sse")

tool_spec = MCPToolSpec(client=client)

tools = tool_spec.to_tool_list()

# tools передаёте в FunctionCallingAgent с Ollama LLM

LM Studio: MCP сервер в два клика

LM Studio с версии 0.3.17 выступает как MCP хост. Вы можете подключать MCP серверы через редактирование mcp.json или через кнопку «Add to LM Studio», где она доступна.

Как добавить MCP сервер в LM Studio

Открываете LM Studio, идёте в правую боковую панель, кликаете вкладку Program (иконка терминала). В разделе Install нажимаете Edit mcp.json. Файл открывается во встроенном редакторе, изменения применяются автоматически при сохранении.

Пример mcp.json с несколькими серверами:

{

"mcpServers": {

"filesystem": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-filesystem", "/path/to/projects"]

},

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_TOKEN": "ваш_токен"

}

}

}

}Файл mcp.json живёт в ~/.lmstudio/mcp.json на macOS и Linux, и в %USERPROFILE%/.lmstudio/mcp.json на Windows. Для Windows важно: пути разделяйте двойными обратными слэшами (\\).

Каждый MCP сервер запускается в отдельном изолированном процессе. LM Studio поддерживает серверы, которые зависят от npx, uvx или любой системной команды — главное, чтобы эти инструменты были доступны в PATH.

Подтверждение вызова инструментов

Когда модель пытается вызвать инструмент через MCP сервер, LM Studio показывает диалог подтверждения: вы можете просмотреть, одобрить, изменить или отклонить вызов. Инструменты можно добавить в белый список для будущих вызовов.

Это критично для продуктивной работы: не хочется кликать «разрешить» каждый раз при чтении файла. После первого одобрения добавляете в whitelist — и работаете спокойно.

Максим: «Мы тестировали LM Studio с MCP на реальных задачах — парсинг репозитория и поиск по файлам. Qwen3:14B справляется нормально, но если задача сложная и инструментов больше трёх, лучше взять модель побольше или переключиться на Claude Sonnet. Время экономит, нервы тоже.»

Какие модели работают с MCP через Ollama

Не каждая модель в Ollama умеет tool calling. Если модель игнорирует ваши инструменты и просто отвечает текстом — она не поддерживает нужный формат.

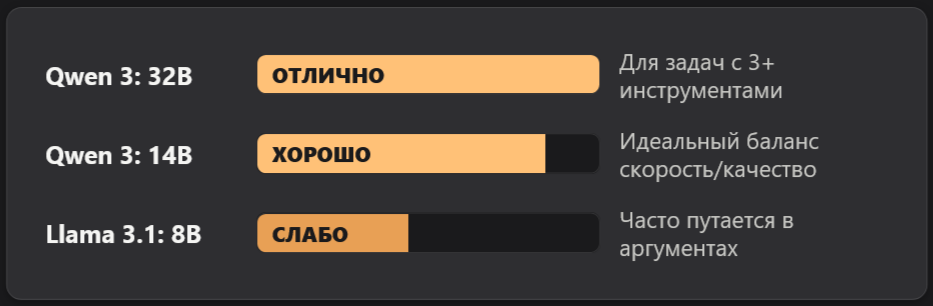

Среди моделей, которые хорошо работают с tool calling: Qwen 3 (все размеры), Llama 3.1/3.3, Mistral, Hermes 3, Gemma 4 и GLM-4. Для MCP практический минимум — 14B параметров. Qwen 3 32B — самый надёжный вариант для сложных многоинструментальных сценариев.

| Модель | Параметры | Tool calling | Рекомендация |

|---|---|---|---|

| Qwen3:32b | 32B | Отлично | Сложные задачи с несколькими инструментами |

| Qwen3:14b | 14B | Хорошо | Баланс скорость/качество |

| Llama3.3:70b | 70B | Отлично | Если есть видеокарта с памятью |

| Llama3.1:8b | 8B | Нестабильно | Только простые сценарии |

| DeepSeek V3.2 | разные | Хорошо | Через Ollama Cloud |

Практический совет: начните с Qwen3:14b. Скачайте командой ollama pull qwen3:14b, проверьте что модель запущена через ollama list, и смотрите в описании — должна быть строчка Capabilities: completion tools.

Транспорты: stdio vs SSE — в чём разница

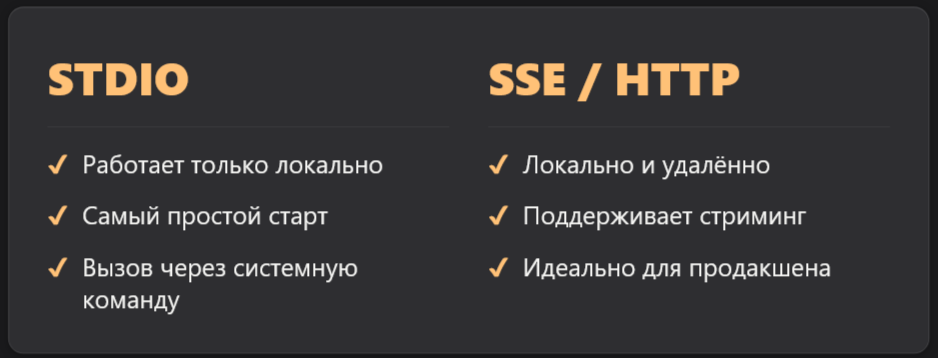

Два способа, которыми MCP сервер передаёт данные клиенту.

stdio (standard input/output) — сервер и клиент общаются через стандартный ввод-вывод терминала. Работает только локально. Самый простой вариант для экспериментов, не требует поднимать HTTP-сервер. В mcp.json выглядит как "command": "npx", "args": [...].

SSE (Server-Sent Events) — общение через HTTP. Сервер слушает на порту, клиент подключается по URL. Подходит и для локального запуска, и для удалённых серверов. Поддерживает стриминг ответов. В mcp.json выглядит как "url": "http://localhost:8000/sse".

Для LM Studio: оба варианта работают. Локальные серверы через stdio проще настроить, удалённые или серверы с веб-интерфейсом — через SSE/HTTP.

Для Ollama через MCPHost или собственный клиент: в видеоматериалах авторы рекомендуют SSE для продуктивного использования, stdio — для разработки и отладки.

Реальные сценарии: где это работает, а где нет

Работает хорошо

Работа с файловой системой. Подключаете @modelcontextprotocol/server-filesystem, модель читает ваши проекты, ищет по файлам, создаёт и редактирует. Полная приватность, данные никуда не уходят.

Локальная база данных. SQLite через MCP сервер + Ollama — стандартный учебный пример из видео. Модель принимает запросы на естественном языке, конвертирует в SQL, возвращает данные. Для корпоративных данных, которые нельзя отдавать в облако, это реальный вариант.

Разработка и отладка MCP серверов. LM Studio с версии 0.3.17 поддерживает как локальные, так и удалённые MCP серверы. Можно тестировать свой сервер локально, потом подключать к нему любой клиент.

Работа с мессенджерами и внешними API. Из видео: WhatsApp/Slack интеграция через MCP, доступ к файловой системе для подсчёта директорий. Если у сервиса есть MCP сервер, подключаете за пять минут.

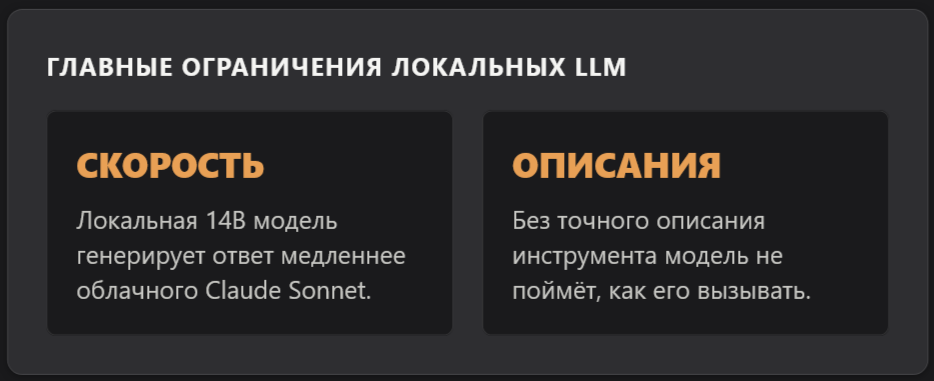

Есть нюансы

Качество работы меньших моделей. Qwen3:8b справляется с простыми инструментами нормально, но на сложных сценариях с тремя-четырьмя инструментами начинает путаться. Нужно либо больше параметров, либо очень детальные описания инструментов.

Скорость. Локальная 14B модель работает медленнее облачного Claude Sonnet. Если задача срочная — это ощутимо.

Описания инструментов решают всё. Из транскрипции видео: для локальных LLM особенно важно давать максимально чёткое описание каждого инструмента, его параметров, схемы и примеров. Без этого модель часто не понимает, когда и как его вызывать.

Пошаговая настройка: LM Studio + локальный MCP сервер

Покажем на примере подключения сервера для работы с файлами.

Шаг 1. Убедитесь, что Node.js установлен. Проверьте: node --version.

Шаг 2. Откройте LM Studio, зайдите в Program tab → Install → Edit mcp.json.

Шаг 3. Добавьте конфиг:

{

"mcpServers": {

"filesystem": {

"command": "npx",

"args": [

"-y",

"@modelcontextprotocol/server-filesystem",

"/Users/yourname/projects"

]

}

}

}Шаг 4. Сохраните файл — LM Studio автоматически подгрузит сервер.

Шаг 5. Загрузите модель с поддержкой tool calling (Qwen3:14b рекомендуется). Начните новый чат и спросите что-то про файлы в указанной папке.

Шаг 6. При первом вызове инструмента появится диалог подтверждения. Одобрите и при желании добавьте в whitelist.

Если сервер не подхватывается: проверьте что npx есть в PATH, перезапустите LM Studio, откройте встроенный инспектор для отладки (в документации LM Studio).

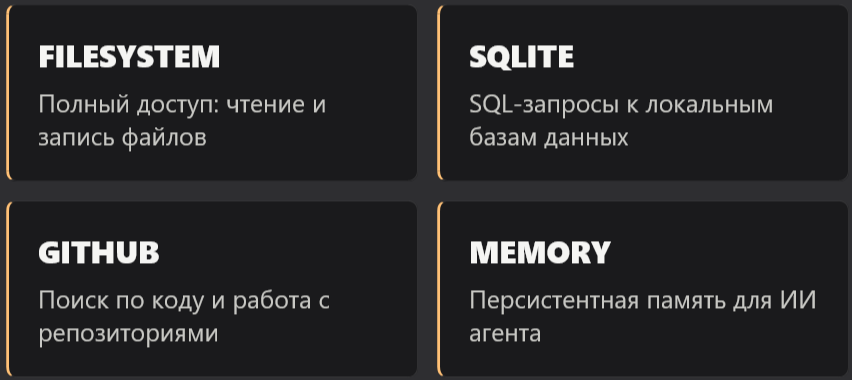

Лучшие MCP серверы для локального использования

Несколько серверов, которые хорошо сочетаются с локальным стеком:

| MCP сервер | Что делает | Установка |

|---|---|---|

| filesystem | Чтение/запись файлов | npx @modelcontextprotocol/server-filesystem |

| sqlite | SQL-запросы к локальной БД | npx @modelcontextprotocol/server-sqlite |

| github | Работа с репозиториями | npx @modelcontextprotocol/server-github |

| brave-search | Поиск в интернете | Нужен API-ключ Brave |

| memory | Персистентная память агента | npx @modelcontextprotocol/server-memory |

Каталог серверов: github.com/modelcontextprotocol/servers — официальный реестр от Anthropic.

Глоссарий

MCP (Model Context Protocol) — открытый стандарт для подключения LLM к внешним инструментам и источникам данных. Разработан Anthropic, открытый исходный код.

MCP хост — приложение, которое выступает как MCP клиент: LM Studio, Claude Desktop, Cursor, ваш собственный агент.

Tool calling — способность LLM вызывать функции (инструменты) с передачей аргументов. Не все модели Ollama это умеют.

stdio — транспорт для MCP через стандартный ввод-вывод. Только локально.

SSE (Server-Sent Events) — транспорт для MCP через HTTP. Работает и локально, и удалённо.

MCPHost — Go CLI-инструмент для подключения Ollama к MCP серверам без написания кода.

LlamaIndex / LangChain — Python-фреймворки для создания агентов. Умеют работать с MCP инструментами.

Частые вопросы

Поддерживает ли Ollama MCP нативно?

Нет. По состоянию на май 2026 года Ollama — inference-сервер с tool calling, но не MCP клиент. Для связки с MCP серверами нужен мост: MCPHost, mcp-client-for-ollama или собственный клиент на Python.

Какая минимальная модель для нормальной работы с MCP?

На практике 14B параметров. Модели 7-8B работают нестабильно при сложных инструментах или когда инструментов несколько. Qwen3:14b — хороший старт.

LM Studio передаёт данные в облако?

Нет, если вы используете локальную модель и локальные MCP серверы. Данные остаются на вашем железе. Если подключаете удалённый MCP сервер (например, GitHub) — данные уходят к нему, не к Anthropic/OpenAI.

Можно ли подключить Ollama к Claude Desktop?

Да, через специальный MCP сервер-мост (LMStudio-MCP или аналоги). Тогда Claude Desktop будет использовать вашу локальную модель через LM Studio API. Но сам Claude Desktop при этом всё равно подключается к серверам Anthropic.

Как отлаживать MCP сервер?

В документации LM Studio упоминается встроенный отладчик. Для Ollama через MCPHost есть команда /servers в терминале, которая показывает все подключённые серверы и доступные инструменты.

Работает ли это на Windows?

Да, с нюансом: в mcp.json для Windows используйте двойные обратные слэши в путях (\\). LM Studio доступен для Windows, macOS и Linux.

Какие MCP серверы самые популярные?

Файловая система, GitHub, память (персистентный контекст), SQLite, браузер (Playwright). Полный список — modelcontextprotocol.io.

Итог

Локальный MCP стек работает — факт. Ollama даёт вам inference без облака, LM Studio берёт на себя роль MCP хоста с простым конфигом, MCPHost или mcp-client-for-ollama соединяют всё вместе для терминальных сценариев.

Честное ограничение: качество локальных моделей пока уступает Claude Sonnet или GPT-4o на сложных агентных задачах с несколькими инструментами. Если данные позволяют уйти в облако — там будет быстрее и надёжнее. Если нет — локальный стек решает задачу приватности полностью.

Посмотрите каталог AI-инструментов на нашем портале — там есть обзоры Ollama, LM Studio и других инструментов для локального вайбкодинга. Если хотите разобраться, какой стек подойдёт под вашу задачу — запишитесь на консультацию к Максиму.

Обновлено: май 2026