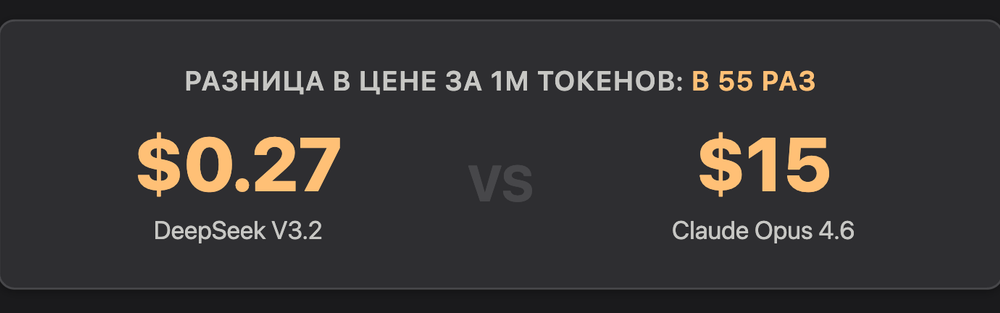

DeepSeek V3.2 стоит $0.27 за миллион входящих токенов. Claude Opus 4 — $15. Разница в 55 раз. При этом на большинстве задач кодинга DeepSeek V3.2 выдает результат, неотличимый от топовых моделей. В этой статье разберем, как подключить DeepSeek к Curs…

10+ лет в маркетинге, 300+ клиентских проектов: сайты, реклама, боты. Создатель GoBanana (228K+ пользователей, 11.6 млн ₽ выручки) и VibeCoderz. Делаю AI-продукты сам через Claude Code, Cursor, Windsurf и консультирую тех, кто хочет так же.

Об авторе →Claude Code

free

Claude Code — это автономный AI-агент от Anthropic, который живёт прямо в вашем терминале, сам читает файлы, запускает тесты и пишет код без постоянного микроменеджмента.

Cursor

free

Cursor — это AI-нативная IDE (интегрированная среда разработки) на базе VS Code, которая превращает написание кода в управление автономными ИИ-агентами.

Aider

free

Aider — это бесплатный AI-ассистент для терминала, который работает напрямую с вашим Git-репозиторием и пишет код с помощью любых доступных LLM-моделей.

Какая нейросеть лучше пишет код в 2026: честный тест Claude, DeepSeek и GPT

Коротко: в мае 2026 года для написания кода лидирует Claude Opus 4.7 по верифицированному SWE-bench Pro (64.3%), GPT-5.5 выигрывает в терминальных задачах (82.7% Terminal-Bench), а DeepSeek V4 — это лучший вариант, когда нужно сэкономить: в 6 раз деш…

Лучшие AI IDE в 2026: честный рейтинг Cursor, Windsurf, Claude Code и конкурентов

Cursor, Windsurf, Claude Code, Antigravity, Kiro, Zed — каждый заявляет, что он лучший AI редактор кода. Рынок за два года прошёл путь от автодополнения строк до параллельных агентов, которые самостоятельно пишут, тестируют и деплоят код. Выбирать ст…

Как подключить MCP сервер к Cursor и Claude: пошаговый гайд с командами

MCP сервер подключается через JSON-конфиг в одном из двух мест: для Cursor это ~/.cursor/mcp.json или .cursor/mcp.json в корне проекта, для Claude Desktop — ~/.claude/claude_desktop_config.json, для Claude Code — команда claude mcp add прямо в термин…

MCP сервер для Figma: как AI начинает видеть ваш дизайн и генерировать точный код

Figma запустила официальный MCP сервер — теперь AI-агент в Cursor или Claude Code видит ваш дизайн напрямую и генерирует код с учетом реальных переменных, компонентов и Auto Layout. Никаких скриншотов и описаний от руки.

Как создать свой MCP сервер на Python за один вечер: гайд с примером

MCP сервер на Python пишется примерно за 50 строк кода. Официальный SDK от Anthropic настолько хорошо сделан, что рабочий инструмент для Claude Code или Cursor получается быстрее, чем настройка любого REST API.

Где найти MCP серверы: 6 каталогов и репозиториев с тысячами инструментов

MCP серверы — это расширения для Cursor, Claude Code, Windsurf и других AI-инструментов, которые дают им доступ к внешним сервисам: базам данных, GitHub, Notion, браузеру и ещё тысячам источников. К маю 2026 экосистема MCP насчитывает более 14 000 пу…

DeepSeek V3.2 стоит $0.27 за миллион входящих токенов. Claude Opus 4 — $15. Разница в 55 раз. При этом на большинстве задач кодинга DeepSeek V3.2 выдает результат, неотличимый от топовых моделей. В этой статье разберем, как подключить DeepSeek к Cursor, Aider и Claude Code, где модель реально тянет, а где сдается, и что учесть тем, кто осторожничает с данными в китайских системах.

Что узнаете: что такое DeepSeek V3.2 и R1, как выглядят реальные цены, как подключить к основным инструментам вайбкодинга, где работает хорошо, где — нет, и какие есть альтернативы для тех, кто думает о конфиденциальности.

DeepSeek — китайская лаборатория, которая в конце 2024 года выпустила серию моделей с открытыми весами. Это значит, что веса можно скачать и запустить локально — без отправки данных на чужие серверы.

Модели сразу вызвали ажиотаж: по качеству они вплотную приблизились к Claude Sonnet и GPT-4, а по цене API оказались в 10-60 раз дешевле. Для вайбкодеров, которые гоняют тысячи токенов в час через Cursor или Aider, это принципиальная разница.

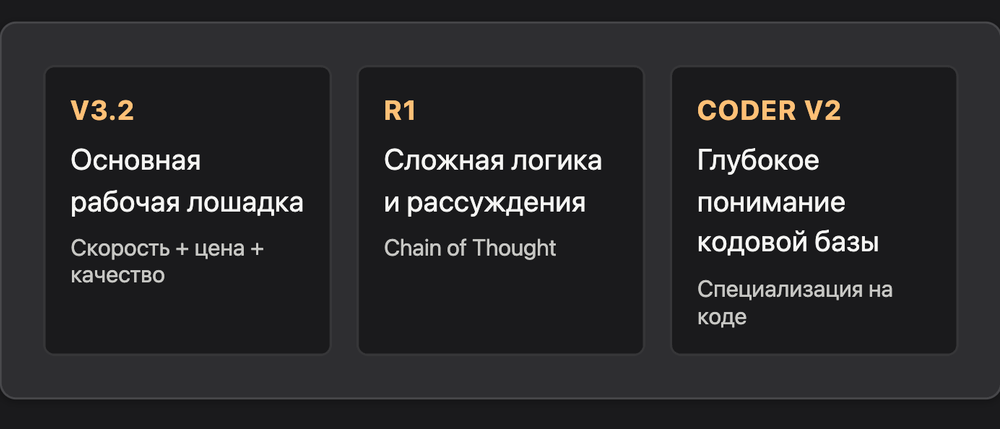

В таблице ниже ключевые модели, которые реально используются для кодинга:

| Модель | Что делает | Контекст | Сильная сторона |

|---|---|---|---|

| DeepSeek V3.2 | Основная рабочая лошадка | 128K токенов | Скорость + цена + качество кода |

| DeepSeek R1 | Reasoning (рассуждения) | 64K токенов | Chain of Thought, сложная логика |

| DeepSeek Coder V2 | Специализация на коде | 128K токенов | Понимание кодовой базы |

DeepSeek V3.2 — апгрейд V3, вышедший в 2025 году. Именно его чаще всего сравнивают с Claude Sonnet, и именно на него стоит ориентироваться для большинства задач вайбкодинга.

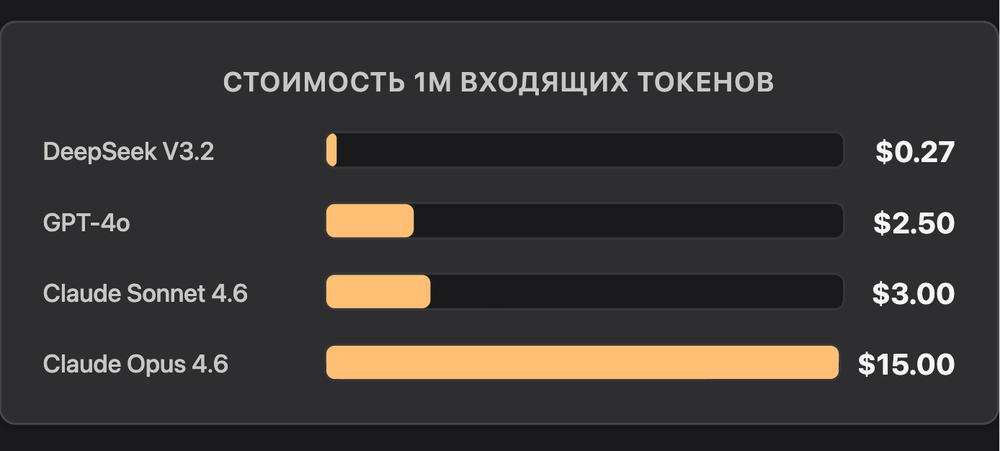

Самый честный способ сравнить — поставить рядом цены API за миллион токенов. Вот актуальная картина на апрель 2026:

| Модель | Входящие токены (1M) | Исходящие токены (1M) |

|---|---|---|

| DeepSeek V3.2 | $0.27 | $1.10 |

| DeepSeek R1 | $0.55 | $2.19 |

| Claude Sonnet 4.6 | $3.00 | $15.00 |

| Claude Opus 4.6 | $15.00 | $75.00 |

| GPT-4o | $2.50 | $10.00 |

| GPT-4.1 | $2.00 | $8.00 |

Если вы тратите через Cursor или Aider 10 миллионов токенов в месяц (реальная цифра для активной разработки), то с Claude Sonnet это $300-450, а с DeepSeek V3.2 — около $15-20. Разница в бюджете очевидна.

Важная оговорка: когда вы используете DeepSeek через Cursor по подписке, цены немного другие — инструмент агрегирует запросы.

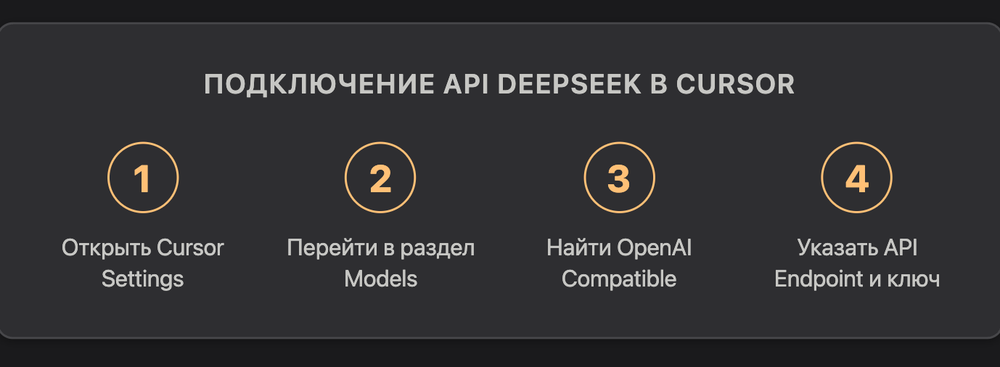

Cursor добавил поддержку DeepSeek начиная с версии 0.45.4. Если у вас старше — обновитесь, иначе модели просто не появятся в списке.

Пошаговое подключение:

https://api.deepseek.com/v1 и вставьте ключ с платформы platform.deepseek.com

Практика использования по задачам:

Для написания нового кода — DeepSeek V3.2 в Agent Mode работает хорошо. Пишет чистый код, понимает контекст проекта через @codebase.

Для сложного планирования перед кодингом — R1 с Chain of Thought. Видите, как модель рассуждает, можете на ходу скорректировать направление до того, как она начнет генерировать код.

Для быстрых правок — V3.2 в обычном режиме. Не нужен агент, не нужен R1. Просто выделяете блок кода и просите исправить.

Один важный нюанс из практики: DeepSeek в Agent Mode поддерживается начиная с определенных версий Cursor. Если агент не работает — проверьте, что версия актуальная и модель выбрана явно, а не стоит "Auto".

Aider — консольный инструмент для вайбкодинга, который работает прямо из терминала. Он подключается к любому OpenAI-совместимому API, и DeepSeek идеально ложится в эту схему.

Подключение через переменные окружения:

export DEEPSEEK_API_KEY=your_key_here

aider --model deepseek/deepseek-chatИли для R1 (reasoning):

aider --model deepseek/deepseek-reasonerПочему Aider + DeepSeek — один из самых дешевых стеков для вайбкодинга:

Aider оптимизирован под минимальный расход токенов. Он не гоняет весь контекст при каждом запросе, а умно кэширует и отправляет только нужные части. В связке с ценой DeepSeek получается рабочий стек буквально за копейки.

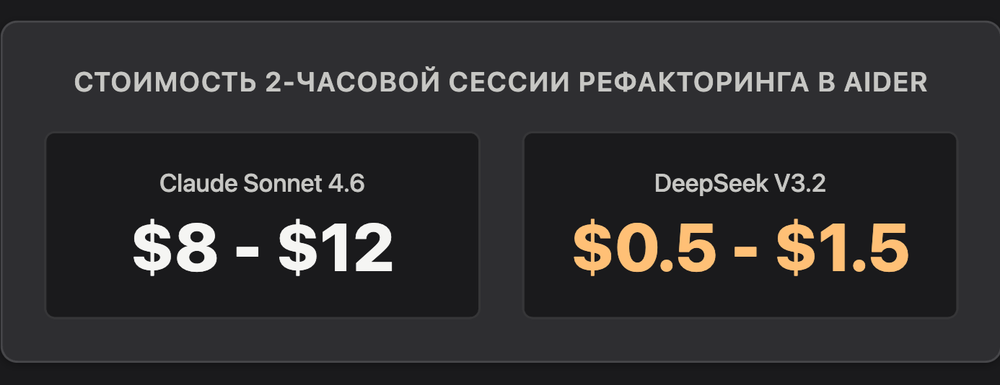

Практическое сравнение: сессия рефакторинга среднего Python-проекта (около 5000 строк кода, 2 часа работы) с Claude Sonnet обойдется примерно в $8-12. Та же сессия с DeepSeek V3.2 — $0.5-1.5.

Claude Code — терминальный агент от Anthropic, который изначально заточен под собственные модели. Но через механизм кастомных провайдеров его можно подключить к DeepSeek.

Есть два способа:

Способ 1 — через OpenRouter. OpenRouter агрегирует множество моделей под единый OpenAI-совместимый интерфейс. DeepSeek там есть. Устанавливаете OPENAI_API_KEY=ваш_ключ_openrouter и OPENAI_BASE_URL=https://openrouter.ai/api/v1, указываете модель deepseek/deepseek-chat-v3-5.

Способ 2 — напрямую через DeepSeek API. Аналогично, указываете base URL платформы DeepSeek и ключ. Работает, но Claude Code изредка может вести себя неожиданно — все-таки изначально оптимизирован под Anthropic-форматы.

Честная оговорка: Claude Code + Claude — это связка, которая сделана друг для друга. Переключение на DeepSeek экономит деньги, но вы теряете часть интеграции. Если бюджет не критичен — лучше оставить Claude. Если нужна экономия на объемных задачах — DeepSeek V3.2 справляется.

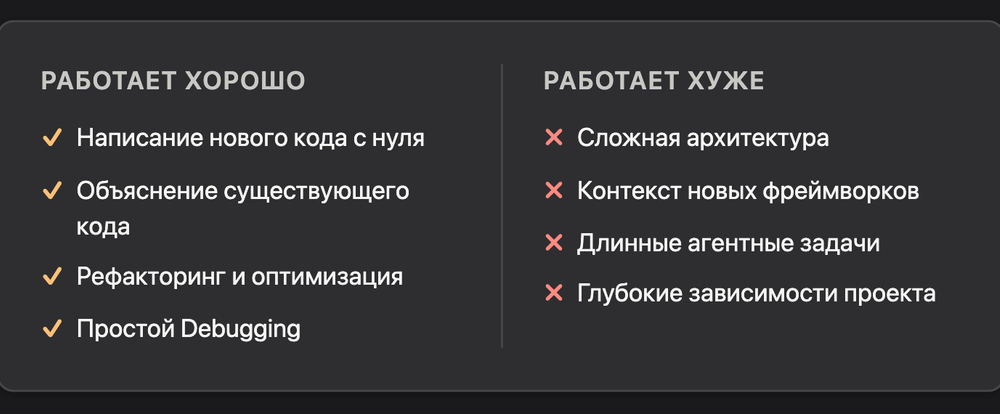

Работает хорошо:

Написание нового кода с нуля. DeepSeek V3.2 по качеству генерации сопоставим с Claude Sonnet 4.6 на большинстве стандартных задач — React-компоненты, API-эндпоинты, скрипты автоматизации.

Понимание и объяснение существующего кода. Даете большой кусок — получаете внятное объяснение. Работает с Python, TypeScript, Go, Rust.

Рефакторинг и оптимизация. Переписать функцию, вычистить дублирование, улучшить читаемость — со всем этим V3.2 справляется уверенно.

Debugging с подсказками. Если показываете ошибку с контекстом — находит причину и предлагает фикс.

Работа с документами и анализ. Если нужно проанализировать файл, таблицу или сделать структуру из текста, DeepSeek закрывает 80% таких задач без проблем.

Работает хуже:

Сложные архитектурные решения для больших проектов. Здесь Claude Opus или GPT-4.1 надежнее — глубже понимают зависимости и дают более обоснованные решения.

Тонкий контекст фреймворков. Если работаете с нестандартными или очень новыми библиотеками — у DeepSeek меньше покрытие в обучающих данных.

Длинные многоходовые задачи в агентном режиме. R1 помогает, но Claude лучше держит цель на протяжении длинных сессий.

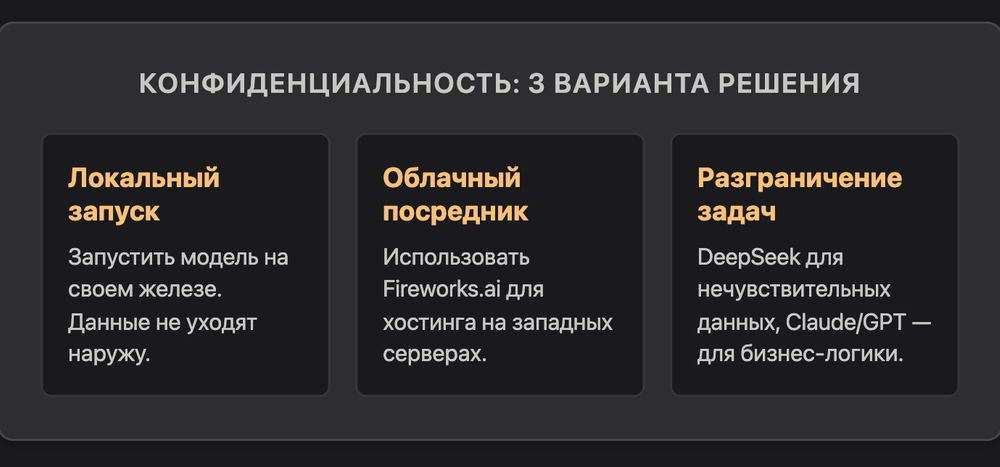

Это реальная проблема, которую стоит назвать прямо: когда вы отправляете запросы на DeepSeek API, данные уходят на серверы в Китае. Для коммерческих проектов с чувствительным кодом это может быть критично.

Три варианта решения:

Вариант 1 — Локальный запуск. DeepSeek открывает веса, поэтому вы можете запустить модель на своем железе. RTX 3060 тянет облегченные версии, полноценный V3.2 требует серьезного GPU или несколько карт. Медленнее, но ни один токен не уходит наружу.

Вариант 2 — Через облачного посредника. Fireworks.ai, Together AI и другие платформы хостят DeepSeek на своей инфраструктуре. Данные обрабатываются на западных серверах. Цена чуть выше, чем у оригинального API, но дешевле Claude.

Вариант 3 — Разграничение задач. Используете DeepSeek для задач, где нет чувствительных данных (шаблонный код, публичные алгоритмы, учебные проекты), и Claude/GPT для работы с бизнес-логикой и проприетарным кодом.

| Критерий | DeepSeek V3.2 | Claude Sonnet 4.6 | GPT-4o |

|---|---|---|---|

| Цена API (вход/выход, $) | 0.27 / 1.10 | 3.00 / 15.00 | 2.50 / 10.00 |

| Качество кода | Очень хорошее | Отличное | Хорошее |

| Сложная архитектура | Среднее | Отличное | Хорошее |

| Chain of Thought | Через R1 | Через Opus | Через o1/o3 |

| Открытые веса | Да | Нет | Нет |

| Конфиденциальность API | Китайские серверы | США | США |

| Интеграция с Cursor | Встроена | Встроена | Встроена |

| Интеграция с Aider | Полная | Полная | Полная |

Для вайбкодера-одиночки, который делает свои проекты и хочет сэкономить — DeepSeek V3.2 это очень разумный выбор. Для команды с корпоративными требованиями к безопасности — нужно думать об инфраструктуре.

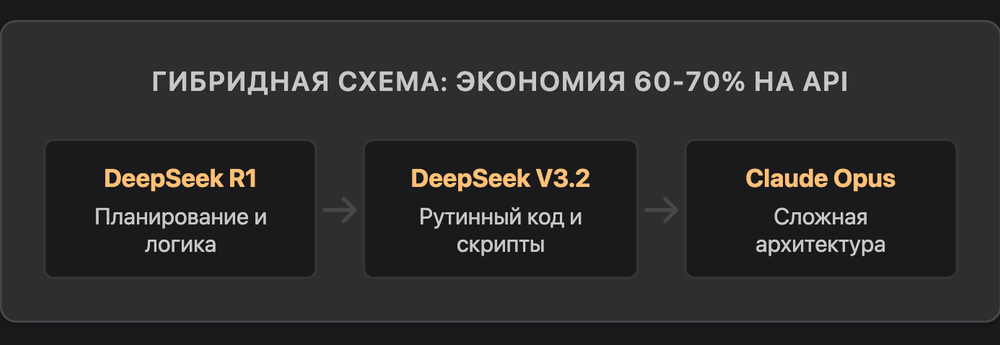

Вместо того чтобы выбирать "или/или", многие вайбкодеры строят гибридную схему:

DeepSeek R1 — для планирования задачи. Запускаете, смотрите Chain of Thought, убеждаетесь, что модель правильно поняла проблему. Это фактически "показывает мышление" перед тем, как браться за код.

DeepSeek V3.2 — для написания стандартного кода, рутинных компонентов, скриптов, которые не содержат бизнес-секретов.

Claude Sonnet 4.6 или Opus — для сложных архитектурных решений, работы с чувствительными данными и там, где нужна максимальная надежность.

Такая схема позволяет сэкономить 60-70% на API без ощутимой потери качества.

Если хотите разобраться глубже с инструментами вайбкодинга:

Если нужна помощь с выбором стека — запишитесь на консультацию к Максиму.

Что лучше для вайбкодинга: DeepSeek V3.2 или R1? V3.2 — для большинства задач: пишет код быстро и дешево. R1 — когда нужно разобраться со сложной логикой или отладить нетривиальный алгоритм. Смотрите Chain of Thought R1 перед тем, как давать V3.2 задачу на реализацию.

Как подключить DeepSeek к Cursor? Начиная с версии 0.45.4 DeepSeek V3 и R1 встроены в Cursor нативно. Идете в Settings → Models и включаете нужную. Если хотите собственный API-ключ — добавляете как OpenAI Compatible с endpoint https://api.deepseek.com/v1.

Насколько DeepSeek дешевле Claude? DeepSeek V3.2 стоит $0.27/M входящих токенов против $3 у Claude Sonnet 4.6 и $15 у Claude Opus. По входящим токенам разница — от 11 раз (Sonnet) до 55 раз (Opus). По исходящим — сопоставимо меньше.

Можно ли запустить DeepSeek локально? Да, веса открыты. Облегченные варианты запускаются даже на RTX 3060, полноценный V3.2 требует несколько топовых карт или NVLink-систему. Для приватного кодинга это лучший вариант.

DeepSeek умеет работать с файлами и документами? Да. Через API и инструменты вроде Cursor или Aider можно передавать файлы в контекст. Анализирует код, PDF, таблицы. По опыту пользователей, закрывает около 80% типичных задач анализа без проблем.

Насколько безопасно отправлять код в DeepSeek API? Запросы уходят на серверы в Китае. Для открытых проектов и учебных задач это не критично. Для проприетарного кода и коммерческих проектов — стоит использовать локальный запуск или хостинг через Fireworks.ai / Together AI.

Поддерживает ли Aider DeepSeek? Да, полностью. Aider работает с любым OpenAI-совместимым API. Указываете ключ и модель через переменные окружения — и все работает.

Chain of Thought (CoT) — режим работы модели, при котором она показывает пошаговые рассуждения перед ответом. В DeepSeek это реализовано через модель R1.

Open weights (открытые веса) — когда компания публикует параметры обученной модели. Можно скачать и запустить локально без подключения к чужому API.

токен — единица текста, которую обрабатывает языковая модель. Примерно 4 символа или 0.75 слова в английском. Именно токенами измеряется расход API.

Reasoning-модель — модель, оптимизированная для многошагового рассуждения. DeepSeek R1, Claude Opus, GPT-o1 — примеры reasoning-моделей.

API-ключ — уникальный идентификатор, который позволяет вашему инструменту (Cursor, Aider) обращаться к модели напрямую и платить за токены самостоятельно.

Fireworks.ai — платформа для хостинга open-source моделей на западной инфраструктуре. Хостит DeepSeek — можно использовать без отправки данных в Китай.

Context window (контекстное окно) — сколько текста модель может "удержать" за один раз. DeepSeek V3.2 — 128K токенов, то есть примерно 90-100 тысяч слов одновременно.

Статья подготовлена командой VibeCoderz — крупнейшей базы знаний по AI IDE и вайбкодингу в СНГ. Последнее обновление: апрель 2026.